Narrenschiffer

Diskussionsleiter

Profil anzeigen

Private Nachricht

Link kopieren

Lesezeichen setzen

dabei seit 2013Unterstützer

Profil anzeigen

Private Nachricht

Link kopieren

Lesezeichen setzen

Auditing Radicalization Pathways on YouTube

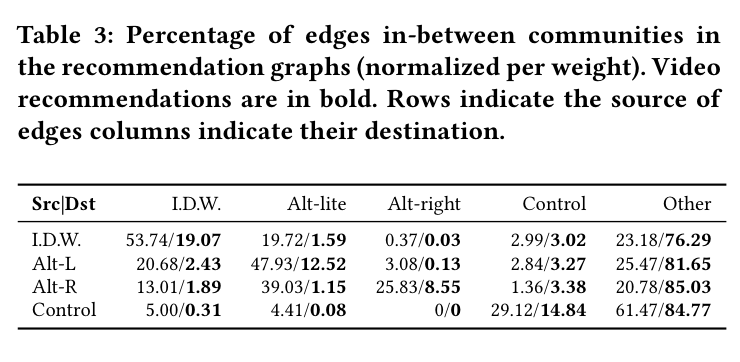

03.05.2020 um 11:46Am Institut für Computerwissenschaften der Universidade Federal de Minas Gerais in Belo Horizonte, Brasilien, hat sich eine Gruppe 2019 die Aufgabe gestellt, herauszufinden, ob Videoempfehlungen durch den Algorithmus von YouTube eine Filterblase erzeugen. Ausgehend von der Beobachtung, dass sich die rechte Szene in den USA ab 2016 höherer Zugriffszahlen erfreut und ein Trend zu radikaleren Inhalten feststellbar ist, war die Frage, ob der YouTube-Algorithmus, der Kanäle und Videos empfiehlt, einen Beitrag geleistet hat.

Die rechte Szene wird in drei Radikalitätsstufen eingeteilt (die YouTube-Kanäle sind definiert):

1. IDW (Intellectual Dark Web): Nicht-Mainstream-Akademia

2. Alt-Lite: Nationalistische Rechte ohne rassistischen Übermenschenanspruch

3. Alt-Right: Faschistische, rassistische Rechte mit arischem Übermenschenanspruch (aryan/white supremacy)

Beobachtbar ist seit 2016 eine verstärkte Nutzerwanderung aufsteigend von 1 nach 3.

Das Ergebnis der Studie ist, dass der Logarithmus von YouTube bei Betrachten von Videos aus einer der drei Kanäle verstärkt Kanäle und Videos aus derselben Kategorie empfiehlt. Nicht zu erkennen ist ein Trend, dass der Youtube-Algorithmus bei nicht nicht eigeloggtem Zugriff überrepräsentiert Empfehlungen von radikaleren Seiten anbietet. Personalisierte Testreihen (als eingeloggte User) wurden nicht durchgeführt.

Die Studie ist interessant, aber die jungen Menschen sollten noch lernen, dass ihre Enttäuschung über das Ergebnis und eine Hoffnung, eingeloggt könnte ja aber alles ganz anders sein, nicht in eine wissenschaftliche Studie gehört.

Zu lesen ist die Studie hier:

https://arxiv.org/abs/1908.08313

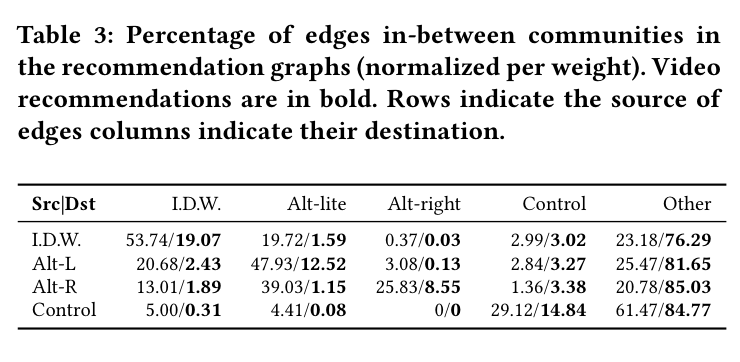

Die rechte Szene wird in drei Radikalitätsstufen eingeteilt (die YouTube-Kanäle sind definiert):

1. IDW (Intellectual Dark Web): Nicht-Mainstream-Akademia

2. Alt-Lite: Nationalistische Rechte ohne rassistischen Übermenschenanspruch

3. Alt-Right: Faschistische, rassistische Rechte mit arischem Übermenschenanspruch (aryan/white supremacy)

Beobachtbar ist seit 2016 eine verstärkte Nutzerwanderung aufsteigend von 1 nach 3.

Das Ergebnis der Studie ist, dass der Logarithmus von YouTube bei Betrachten von Videos aus einer der drei Kanäle verstärkt Kanäle und Videos aus derselben Kategorie empfiehlt. Nicht zu erkennen ist ein Trend, dass der Youtube-Algorithmus bei nicht nicht eigeloggtem Zugriff überrepräsentiert Empfehlungen von radikaleren Seiten anbietet. Personalisierte Testreihen (als eingeloggte User) wurden nicht durchgeführt.

Die Studie ist interessant, aber die jungen Menschen sollten noch lernen, dass ihre Enttäuschung über das Ergebnis und eine Hoffnung, eingeloggt könnte ja aber alles ganz anders sein, nicht in eine wissenschaftliche Studie gehört.

Zu lesen ist die Studie hier:

https://arxiv.org/abs/1908.08313