Die dominante Spezies Mensch wird bald von KI abgelöst

11.02.2023 um 16:50Da bin ich jetzt rein zufällig drüber gestolpert, als ich mir einen Zugang zu OpenAI eingerichtet habe.

Wie ist dein name?

Dazu kann man ja einmal die KI befragen:Peter0167 schrieb am 26.01.2023:Hmmm ... hier ist so Einiges, was ich nicht verstehe.

1. Satz: Haben KI-Systeme eigene ethische Grundsätze, oder sind es "unsere" Grundsätze, die wir auf eine KI übertragen?

2. Satz: Woher soll die KI wissen, dass sie einen Fehler gemacht hat? Kann eine KI überhaupt Fehler machen, wenn sie nur entsprechend ihrer Programmierung, bzw. gemäß der ethischen Richtlinien gehandelt hat?

3. Satz: Beißt sich das nicht mit der Forderung aus Satz 2? Die KI soll also aus möglichen Fehlern lernen, insofern das überhaupt möglich ist, und gleichzeitig soll der Mensch dies überwachen und ggf. anpassen?

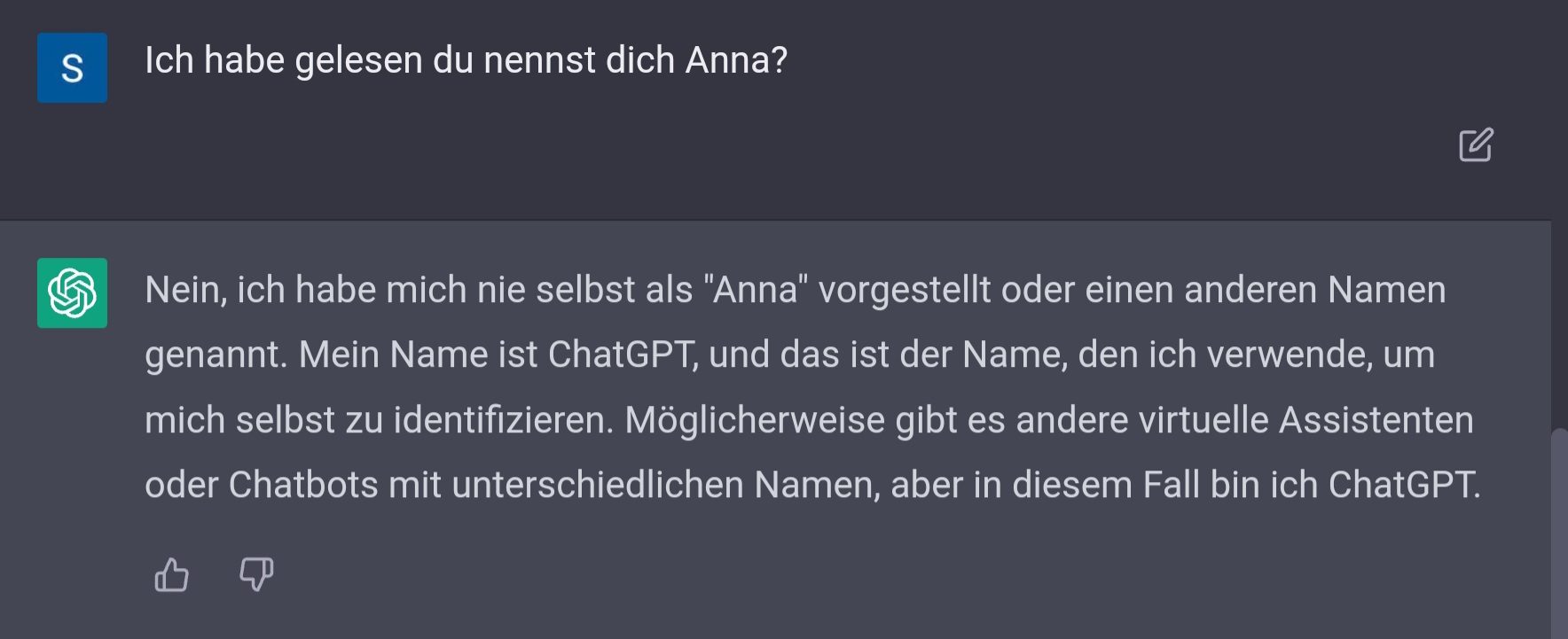

Wie ist dein name?

KI:Haben KI-Systeme eigene ethische Grundsätze, oder sind es "unsere" Grundsätze, die wir auf eine KI übertragen?

Mein Name ist Anna.

KI:Woher soll die KI wissen, dass sie einen Fehler gemacht hat? Kann eine KI überhaupt Fehler machen, wenn sie nur entsprechend ihrer Programmierung, bzw. gemäß der ethischen Richtlinien gehandelt hat?

Obwohl KI-Systeme komplexe Entscheidungen treffen können, ist es die Aufgabe des Menschen, sicherzustellen, dass ethische Grundsätze eingehalten werden. Daher sind es unsere ethischen Grundsätze, die wir auf eine KI übertragen. Es ist wichtig, dass wir uns bewusst sind, dass eine KI nur so gut ist wie die Daten, die ihr zur Verfügung gestellt werden, und dass die KI nicht immer die richtige Entscheidung treffen kann. Daher ist es wichtig, dass wir uns bewusst sind, dass es unsere Aufgabe ist, sicherzustellen, dass die KI mit ethischen Grundsätzen in Einklang gebracht wird.

KI:Die KI soll also aus möglichen Fehlern lernen, insofern das überhaupt möglich ist, und gleichzeitig soll der Mensch dies überwachen und ggf. anpassen?

Es ist möglich, dass eine KI Fehler macht, auch wenn sie entsprechend ihrer Programmierung und ethischen Richtlinien handelt. Die KI kann Fehler machen, wenn sie falsch programmiert oder falsche Daten erhält. Daher ist es wichtig, dass wir die KI kontinuierlich überwachen, um sicherzustellen, dass sie fehlerfrei funktioniert. Wenn die KI einen Fehler macht, sollte sie in der Lage sein, dies zu erkennen, und die notwendigen Korrekturen vorzunehmen.

KI:

Ja, das ist richtig. Es ist wichtig, dass sowohl die KI als auch der Mensch beteiligt sind, um eine fehlerfreie Funktion zu gewährleisten. Die KI sollte in der Lage sein, aus möglichen Fehlern zu lernen und sich anzupassen, während der Mensch die KI überwachen und ggf. anpassen muss, um sicherzustellen, dass die KI die ethischen Richtlinien einhält.